Cybersecure AI en opkomende technologie

De snelle ontwikkeling van AI – en de onvoorspelbare eigenschappen daarvan – maakt het bijzonder lastig om deze technologie te beveiligen tegen cyberaanvallen. Door de integratie van AI in bestaande systemen ontstaan nieuwe soorten kwetsbaarheden. Hoe benut je de voordelen van AI zonder de beveiliging uit het oog te verliezen?

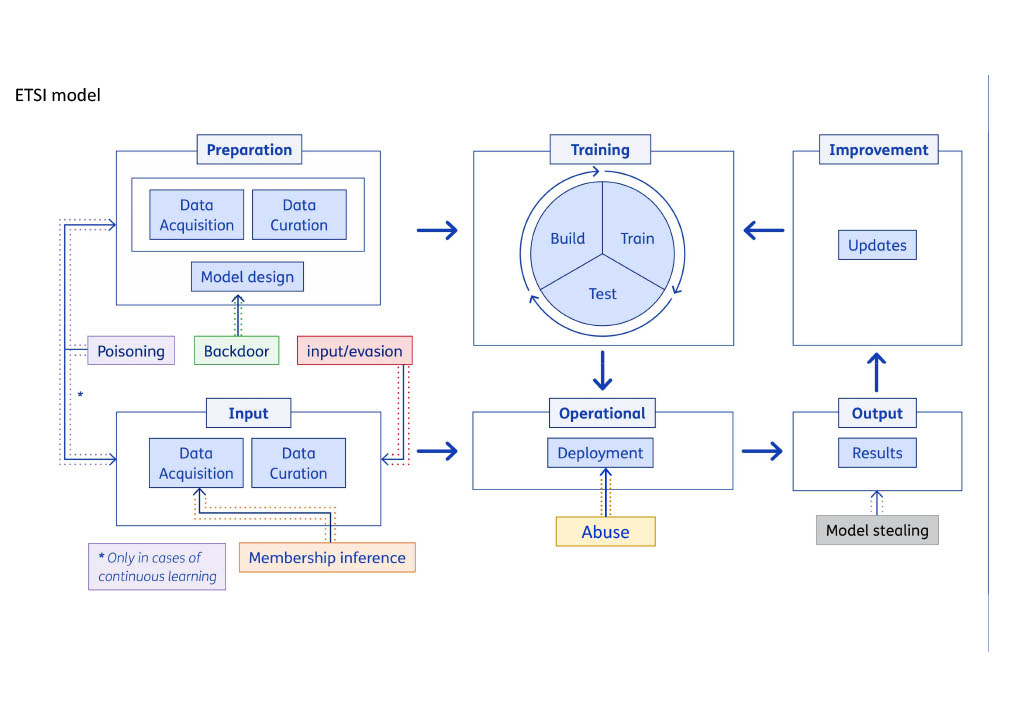

AI beveiligen gedurende de hele levenscyclus

Voordat je AI in je digitale ecosysteem integreert, moet je eerst de specifieke risico's begrijpen en beperken. AI ontwikkelt zich snel en er duiken dagelijks nieuwe kwetsbaarheden op, waardoor beveiliging ook steeds mee moet veranderen. TNO beschikt over de expertise en de tools om ervoor te zorgen dat je AI-oplossingen efficiëntie en snelheid leveren zonder je bloot te stellen aan gerichte aanvallen. Dankzij onze aanpak met een combinatie van diepgaande technische kennis en bewezen methodologieën kun je AI veilig en met een gerust hart inzetten.

Secure-by-design AI

Door vanaf het begin beveiliging te integreren, voorkom je dure en tijdrovende herstelacties achteraf. TNO biedt technische richtlijnen, technologieën en advies. Hierdoor kunnen ontwikkelaars AI-modellen, producten en systemen van meet af aan veilig ontwerpen, bouwen en implementeren. We helpen weerbaarheid te integreren in AI-software om deze robuuster te maken tegen aanvallen en autonome reacties te ontwikkelen op zulke aanvallen.

TNO zorgt ervoor dat nieuwe AI-systemen zo veilig mogelijk kunnen worden uitgerold. We maken alle benodigde controles mogelijk in vitale sectoren zoals beveiliging en defensie, maar ook voor hightech toepassingen in de industrie en daarbuiten. Onze technieken richten zich op het robuuster maken van AI-systemen tegen aanvallen. Vaak wordt AI ingezet om systemen te verdedigen tegen AI-aanvallen. In onze recente publicatie beschrijven we effectieve verdedigingen tegen vijf typen aanvallen die gericht zijn op Machine Learning (ML)-modellen.

AI-veiligheidsbeoordeling en risicobeheer

Op dit moment is er geen algemeen geaccepteerde methode om de veiligheid van AI-systemen te beoordelen of te zorgen dat EU- en Nederlandse regelgeving wordt nageleefd. Vaak beoordelen ontwikkelaars hun eigen modellen, maar ontbreekt het aan onafhankelijke verificatie of die beoordelingen volledig en effectief zijn. TNO biedt een betrouwbaar, onafhankelijk beoordelingskader voor beveiliging om organisaties te helpen bewuste, op risico's gebaseerde beslissingen te nemen die hun AI-oplossingen verder beschermen. Dit kader kan ook als basis dienen voor toekomstige standaarden en methodologieën die zullen uitmonden in duidelijke regels en richtlijnen voor toekomstige AI-ontwikkeling.

Tool: TNO AI Security Hazard Advisor (TAISHA)

De TNO AI Security Hazard Advisor (TAISHA) helpt organisaties om AI‑beveiligingsrisico’s systematisch in kaart te brengen. De tool brengt de belangrijkste kenmerken van een AI‑toepassing samen, zoals het gebruikte model, het type data en de context waarin de toepassing wordt ingezet. Op basis daarvan laat TAISHA zien welke beveiligingsmaatregelen nodig zijn en waar de grootste risico’s en prioriteiten liggen. De uitkomsten ondersteunen risicobeheer, compliance met wet‑ en regelgeving en goed onderbouwde besluitvorming op bestuurs‑ en directieniveau. Ga aan de slag met TAISHA:

AI red teaming

Zodra een AI-systeem is ontwikkeld, moet het grondig worden getest en beoordeeld op weerbaarheid tegen aanvallen. Met AI red teaming levert TNO de tools en technische richtlijnen om adversarial aanvallen op modellen te simuleren. Hierdoor komen AI-specifieke gebreken aan het licht en wordt de robuustheid en weerbaarheid van het systeem actief getest.

Onze zeer technische red teaming-technieken zijn afgestemd op het type AI dat we testen. Bij het testen van LLM-systemen voeden we het systeem bijvoorbeeld met adversarial prompts om ongewenste antwoorden uit te lokken. Wanneer we te maken hebben met een beeldverwerkingssysteem, moeten we adversarial samples maken door onzichtbare ruis aan afbeeldingen toe te voegen om een correcte classificatie van het model te verstoren. Tot slot testen we voor modellen die zijn getraind met gevoelige gegevens of deze gegevens uit deze modellen kunnen worden gehaald. In alle gevallen proberen we met red teaming te bevestigen of we beveiligingslekken in het AI-systeem kunnen uitlokken. Dit moet nieuwe inzichten opleveren om risico's te helpen beperken.

De beveiliging van Large Language Models (LLMs) is een bijzondere uitdaging omdat ze breed en op tal van manieren worden ingezet. TNO neemt actief deel aan een gezamenlijk onderzoeksproject van PCSI om erachter te komen hoe de toegang, rechten en reikwijdte van LLMs kunnen worden gecontroleerd zonder de voordelen ervan te belemmeren. Het onderzoek zal bijdragen aan een LLM-beveiligingsbenchmark met behulp van open-source LLM-beveiligingsbeoordelingstools, zodat LLM veiliger kan worden ingezet.

Verbinding met betrouwbare AI

De veiligheid van AI is een deelgebied binnen het bredere veld van betrouwbare AI. Bij TNO beschikken we over expertise in alles wat met betrouwbare AI te maken heeft.

We stemmen AI-toepassingen af op onze maatschappelijke kernwaarden zoals transparantie, eerlijkheid, verantwoording, privacy en meer. Omdat het gedrag van AI niet volledig voorspelbaar kan worden gemaakt, is het essentieel om de nodige beschermingen en processen eromheen te bouwen. Dit zorgt ervoor dat systemen en platforms betrouwbaar genoeg zijn om de fouten, onschuldige storingen en onvoorspelbare uitkomsten die inherent zijn aan AI te bestrijden.

TNO werkt ook aan privacy enhancing technologies (PET's). Gegevens zijn de drijvende kracht achter AI-innovatie en TNO kan je helpen ervoor te zorgen dat je gegevens robuust zijn en veilig blijven om dit waardevolle bedrijfsmiddel te beschermen. We passen technologieën zoals federated learning en multi-party computation (MPC) toe om gegevens te beschermen tegen aanvallen tijdens zowel de trainingsfase als de operationele fase. We nodigen je uit om contact op te nemen met TNO, in welk stadium van AI-ontwikkeling je je ook bevindt.

Podcast

In deze aflevering van TNO Insights duiken we in de kruising tussen cybersecurity en AI. Wat zijn de belangrijkste bedreigingen die AI vormt voor cybersecurity? Waar kan het juist een oplossing bieden? En hoe kunnen beleidsmakers zich voorbereiden op de toekomst?

Beveiliging voor opkomende technologieën

Naast AI brengen ook opkomende technologieën aanzienlijke beveiligingsrisico's met zich mee. Van 6G-telecommunicatie tot IoT-apparaten en van satellietcommunicatie tot quantumnetworking: met de opkomst van nieuwe en complexe technologieën ontstaan er ook nieuwe kwetsbaarheden. Door de snelle introductie van AI- of ML-apparaten, -systemen en -toepassingen rijst de vraag in hoeverre we deze effectief kunnen beveiligen en deze beveiliging gedurende de hele levensduur van het product of systeem kunnen garanderen.

TNO staat klaar om dit ecosysteem te verkennen en geschikte cybersecurity-oplossingen te ontwikkelen die deze unieke producten en systemen gedurende hun hele levensduur veilig houden. Met onze secure-by-design oplossingen die gekenmerkt worden door autonome veerkracht in combinatie met onze multidisciplinaire expertise en kennis van regelgeving werken we aan een toekomst waarin we kunnen vertrouwen op deze steeds complexere technologieën.

Samen werken aan een veilige toekomst

Ben je bezig met de ontwikkeling van een AI-gestuurde technologie of een nieuw productconcept en wil je er zeker van zijn dat deze veilig, robuust en conform de eisen is? Wil je weten hoe veilig je systeem is of in de praktijk testen hoe weerbaar het is? TNO staat klaar om de cyberbeveiligingsoplossingen te ontwikkelen die je nodig hebt om je systemen hun hele levensduur lang veilig te houden.

Neem contact met ons op

Laat je verder inspireren

TNO Unboxed #6: De race tegen de quantumdreiging is al begonnen

Provincie Noord-Brabant, TNO en partners slaan handen ineen voor cyberveiligheid

Autonomous Cyber Resilience

Software- en systeembeveiliging

Geavanceerde detectie en dreigingsbeheer voor IT en OT